近日,由魔搭社区、Arm、安谋科技与此芯科技联合举办的「万物共芯 · 生生不息——端侧AI开发者实践工作坊」在上海成功举办。本次活动作为此芯科技2025生态大会的分会场,围绕高能效异构算力在端侧大模型场景的深度赋能展开,吸引了众多开发者到场体验。

开发者实践工作坊现场

本次工作坊重点展示了基于 此芯P1 平台,结合 Armv9 CPU、Arm Immortalis GPU、“周易”NPU 以及 Arm KleidiAI 软件栈的全链路协同能力。现场更完成了 Qwen30B-A3B 大模型与 Qwen2.5VL(3B / 7B)多模态模型的完整端侧部署,为开发者带来了真实的「手搓大模型」实战体验。

软硬协同:此芯P1 + Arm KleidiAI 加速端侧大模型落地

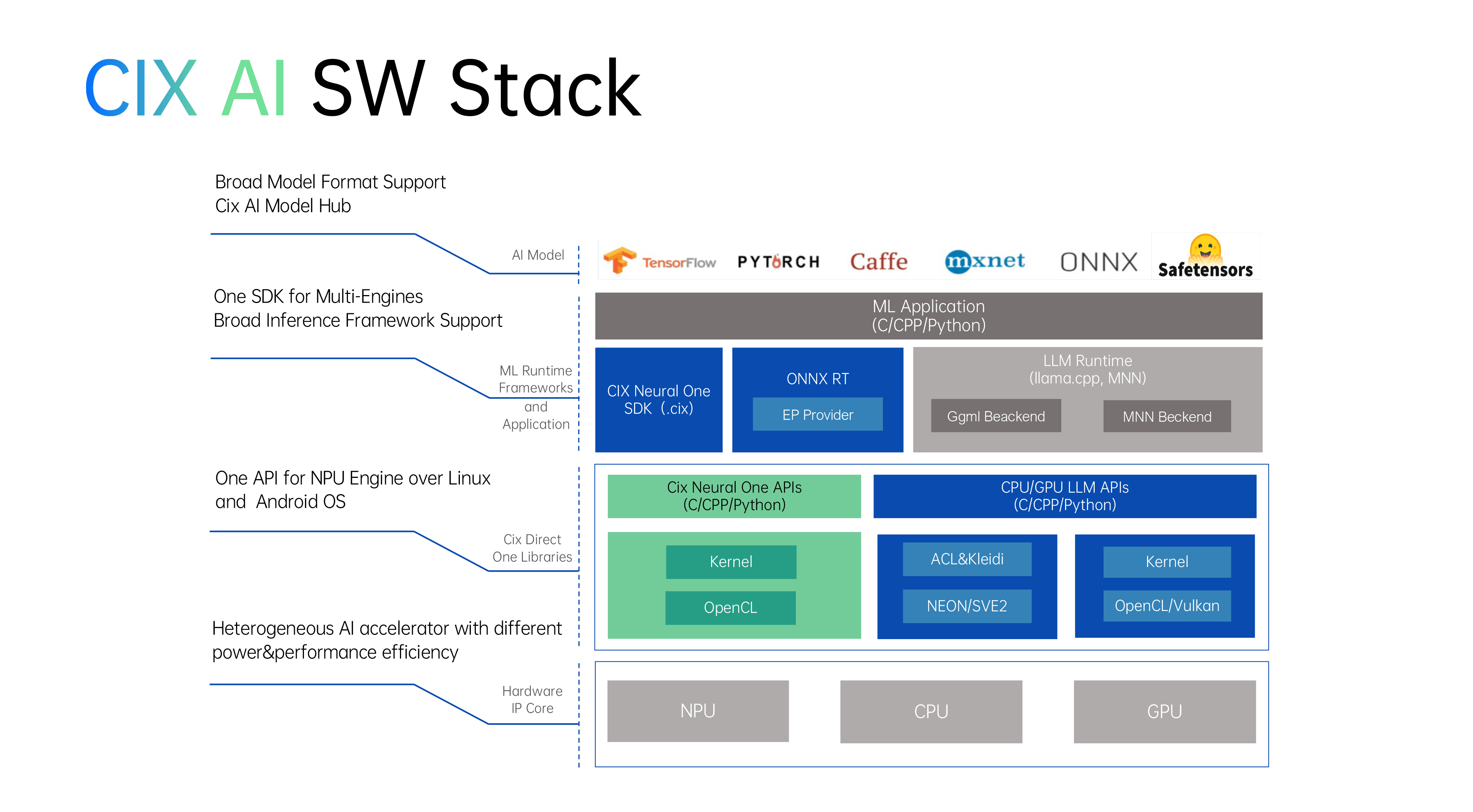

此芯科技AI软件栈

为降低端侧AI开发门槛、加速模型落地,工作坊基于此芯P1高能效算力平台,针对大模型推理展示了异构算力的分工、调度与加速策略。通过 Arm KleidiAI、此芯NOE SDK的深度协同,现场展示了显著的性能提升:

Qwen3-30B-A3B 在端侧的流畅输出

Qwen2.5-VL-3B / 7B 的图文理解与多模态推理性能

这一系列演示充分验证了端侧大模型从“可用”到“好用”的关键技术路径。

深度解析:大模型上板挑战与优化秘籍

此芯科技AI技术专家 田洋

此芯科技AI技术专家田洋为开发者带来主题分享,内容涵盖:

大模型在端侧部署的典型挑战

此芯P1 在 CPU / GPU / NPU 的异构调度策略

大模型量化、算子拆分与高效 Pipeline 构建

多模态模型在端侧的性能优化

如何通过 Arm KleidiAI和此芯NOE SDK最大化地释放硬件潜能

田洋基于 “瑞莎星睿 O6” 开发套件进行现场演示,从模型准备、适配到推理全流程拆解,为现场开发者提供可复用的方法论与实践经验。

开发者实战:亲手部署 QWEN 大模型

开发者实战演练

在90分钟的深度实操环节,开发者亲身体验了:

Qwen3-30B-A3B 的端侧部署与交互对话

Qwen2.5-VL-3B / 7B 的图文推理

基于此芯P1 构建大模型应用的完整流程

在实际体验中,开发者普遍反馈:

性能超出预期,推理运行流畅

NPU + GPU 协同调度高效“丝滑”

Qwen 3B 和 7B 多模态在端侧响应迅速,体验“顺手”

三位来自不同领域的开发者结合自身实践,分享了他们的感受:

开发者代表在现场分享开发实践体验

边缘AI开发者 EPT:

“有幸参加此芯科技的线下工作坊,在搭载此芯P1的瑞莎星睿O6上运行Qwen3模型推理,体验非常优秀。借助此芯强大的算力和完整生态,可以把 Model Hub 中优化后的大模型直接部署到边缘陪伴玩具等场景,为离线部署定制化角色扮演机器人提供了很大支持。”

视觉AI工程师 YC:

“我们要在端侧做多模态模型,用视觉做二次校验,减少误报,比如火焰检测。纯CV方法在光照、反光等情况下误检太多,多模态大模型可以有效减少误报。今天测试下来,这种二次检验非常适合在端侧落地,也开始认真考虑采用此芯的方案。”

独立开发者 H:

“我是独立开发者,有做过离线会议系统。在本地跑大模型做会议纪要时,经常遇到速度慢、上下文越长越卡、显存不够的问题。今天现场体验此芯的SoC方案,生成速度顺畅稳定,效果非常惊喜。这次实践工作坊收获非常大,非常感谢主办方!”

本次工作坊不仅展示了异构计算在大模型部署中的巨大潜力,也验证了端侧 AI 在真实产品落地中的可行路径。此芯科技将继续推动高能效算力平台的研发,并与魔搭社区、Arm、安谋科技及更多生态伙伴携手,加速端侧智能的创新与规模化落地。

此芯科技亮相2026无锡IC设计协同创新论坛,详解Agentic Compute技术演进与CPU核心角色跃迁

此芯P1平台获Ubuntu社区开发者镜像支持,首个中国Arm芯片平台进入Ubuntu生态

异构算力赋能边端智能,此芯科技携手大联大诠鼎推动智能体终端落地

此芯科技精彩亮相联想天禧AI一体多端全场景新品超能之夜

联想 × 此芯 Agentic SoC P1 全球首发AI主机,高算力+超便携,树立 Agentic Compute 行业新标杆

此芯科技市场快讯 (2026年5月)

5月19日 | Agentic Compute开启新纪元

此芯科技与MetaComputing达成战略合作,共推Agentic Compute高性能智能体计算产品